发布时间:2020-12-18 09:25 作者:未知

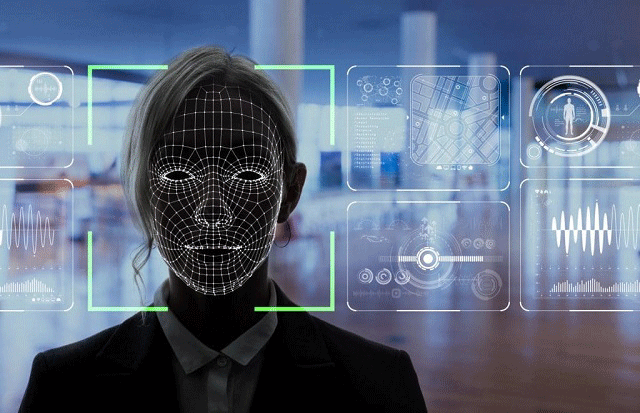

腾佑AI人工智能持续为大家分享基于生物识别技术的人脸识别国际快讯:Idiap研究人员就生物识别公平性指标给出了建议

来自Idiap研究所的一对研究人员已经开发出一种度量,可用于评估生物识别系统的公平性,或者缺乏根据性别和肤色匹配人的不同结果。

由Idiap的Tiago de Freitas Pereira和SébastienMarcel撰写的“生物识别的公平性:评估生物识别验证系统的价值”的论文描述了参考数据库的使用,这些参考数据库旨在代表机器学习开发基准测试阶段的运行条件管道。

但是,这些基准测试过程中显示的准确性在不同的人群之间经常有所不同,这引起了对公平性的关注。

研究人员讨论了可以考虑将生物识别系统视为公平的因素,并提出使用公平差异率(FDR)来衡量准确性差异。长达11页的论文还包括使用面部识别的FDR案例研究。

报告作者写道:“生物测定学界的大多数工作都是通过分别比较不同人口统计群体的DET曲线和/或ROC曲线来评估验证系统的公平性。”“这种类型的比较假设决策阈值是针对特定人群的,这在操作条件下是不可行的,并且不能替代统计分离。FDR通过在假设单一决策阈值的情况下评估人口差异来解决这一问题。”

源代码,训练有素的模型和分数也可以公开获得,以使其他人可以重现作品。

本文中的许多内容都详细介绍了确定FDR的公式,并得出了一个度量标准,他们说,“FDR下的区域”越接近1,就表示公平。在一个示例中,他们称0.999的发现“公平”,其中一个发现0.777“不公平”。

毫不奇怪,在针对三个公共数据集的几个系统的测试中,发现了一些明显的不平衡。

即使决策者试图解决该问题,整个行业仍在继续研究生物识别算法和数据集中的偏倚和公平相关问题。

更多基于生物识别技术的人脸识别国际快讯,腾佑AI人工智能持续分享中,若您有百度人脸识别相关的产品需求,可咨询在线客服获取更多详情!